Es gibt Räume, in denen Menschen Dinge sagen, die sie sonst Niemandem sagen.

- Nicht ihrer Krankenkasse (darüber schrieb ich bereits).

- Nicht der Familie.

- Nicht ihrem Arbeitgeber.

- Nicht einmal (vor) sich selbst besonders gern.

Therapie ist ein solcher Schutzraum. Oder sollte es zumindest sein.

Wer in eine therapeutische Sitzung kommt, bringt nicht einfach Informationen über sich mit. Es geht nicht um beliebige Daten wie eine Lieferadresse, die eigene Schuhgröße oder die Frage „Hafermilch oder normale Milch“ im Kaffee.

Es geht um die Seele bedrängende Fragen oder Unsicherheiten, vielleicht um Ängste, Scham, Konflikte. Um biografisch sensible Momente, manchmal auch um Gedanken, die unfertig vor sich hingären und nur halb spruchreif sind.

In einem therapeutischen Schutzraum dürfen all diese Dinge sein. Jede*r darf laut nachdenken, und auch sich selbst dabei beobachten, wie es ist, etwas „nicht Druckreifes“ auszusprechen.

Genau deshalb ist Datenschutz in der Psychotherapie kein weiterer, bürokratischer Aspekt des Verbraucherschutzes o.ä. Es ist elementarer Bestandteil der Behandlung.

Nicht nur Datenschutz, sondern Beziehungsschutz

Datenschutz ist für mich also ein Bestandteil des therapeutischen Schutzraums. Ein Mensch kann sich dann wirklich öffnen, wenn sie oder er dabei nicht überlegen muss: Wer hört oder liest hier eigentlich mit? Und wo landet das? Wird etwas hiervon irgendwo gespeichert? Wird es gar ausgewertet?

Psychotherapie braucht Vertrauen. Und Vertrauen entsteht nicht durch technische Versprechen, sondern durch eine spürbare Begrenzung: Hier in diesem Raum bleibt das geschützt, was wir besprechen.

Für mich gilt: Ich sitze Ihnen gegenüber, und schreibe analog auf einem Papierblock mit (den ich besonders aufzubewahren verpflichtet bin). Ihre persönlichen Daten habe ich woanders, in einer offline Datenbank. Rechnungen stelle ich einzeln aus mehreren verschiedenen Orten zusammen. Vieles davon ist nicht verpflichtend, aber repräsentiert meine innere Haltung hierbei.

Der Praxisalltag ist digital – völlig ok

Natürlich kann man Praxen nicht zur alten Papierwelt verpflichten, sie nutzen digitale Systeme – das ist für sich völlig ok. Terminverwaltung, Abrechnung, Kommunikation, Dokumentation: All das ist längst Teil des Alltags vieler Praxen – und unterliegt besonderen Datenschutzvorschriften für so genannte „sensible PII Daten“. Ich schreibe diesen Text übrigens auch nicht mit Gänsekiel auf Pergament, während draußen mein Pferd angebunden ist. Ich benutze selbst gerne KI Tools, z.B. um die Bilder für meine Beiträge hier erstellen zu lassen. Ich redigiere therapiefremde, eigene Texte oder recherchiere bestimmte Aspekte lieber im Research Mode einer KI, als mir im Internetbrowser bei einer Suche viel Werbung anzeigen zu lassen. Ich bin also ein ganz normaler Typ, tatsächlich sogar ein kleiner Techniknerd.

Aber gerade weil digitale Werkzeuge so praktisch sind und sich heute nicht mehr wegdenken lassen, möchte ich genau hinsehen, wo hier die sensible Grenze verläuft. Sie wissen (wenn Sie meine anderen Artikel lesen): ich habe Erkenntnistheorie und Massenkommunikationstheorien studiert und meine Uni-Arbeiten waren kommunikationssoziologischer Natur. Ich habe auch in Linguistik Prüfungen absolvier(t/en müssen). Ein LLM, ein Large Language Modell, ist für mich, der ich in Morphologie von meinem Professor gequält wurde, eine faszinierende Entwicklung gewesen, die ich von Anfang an verfolgt habe.

Ich war aber auch vor über 20 Jahren gern bei Sitzungen des Chaos Computer Clubs in der Berliner C-Base, und es ging viel um den Schutz unserer persönlichen Daten in der Zukunft.

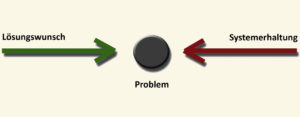

Die Kritische Stelle für mich: wenn KI mithört

Nun also mein Anlass, dies Alles hier zu schreiben. Ich beobachte den Beginn einer für mich problematischen Entwicklung. Aktuell bieten verschiedene Unternehmen, darunter auch eine große Online-Plattform im Gesundheitsbereich (no name dropping), KI-Assistenten für Sprechstunden an. Der Gedanke ist erst mal verführerisch: Während der Sitzung hört eine künstliche Intelligenz zu, erstellt danach eine inhaltliche Zusammenfassung und nimmt somit Therapeut*innen oder Ärzt*innen viel Dokumentationsarbeit ab. Das klingt nach Entlastung, nach Effizienz, nach weniger Schreibkram.

Mir ist klar, dass niemand Psychotherapeut*in wurde, weil sie/er heimlich immer schon Anträge (bei Kassen) bzw. Verwaltungsprosa über „Affektlage“, „Ressourcenaktivierung“ oder „weiteres Vorgehen“ verfassen wollte. Doch bei aller Sympathie für die praktische Entlastung – hier beginnt für mich ein sehr ernstes Problem.

Eine therapeutische Sitzung ist kein Meeting, bei dem ein Bot freundlicherweise das Protokoll schreibt. In der Psychotherapie geht es um exklusiven Kontakt; um Stimme, Pausen, erlaubte Unsicherheiten. Um Widersprüche, die wir gemeinsam angucken, um Scham oder Abwehr, Übertragung-Gegenübertragung, etc.

Wenn nun ein technisches System im Hintergrund mithört, transkribiert, analysiert oder zusammenfasst, verändert zuerst mal psychodynamisch das den gemeinsamen, therapeutischen Raum. Doch viel wichtiger für mich: Wenn eine Cloudbasierte KI die Stimmmerkmale (Charakteristik, verschiedene Metriken) aufzeichnen und auswerten darf, dazu auch die Inhalte alles Gesagten aufzeichnen und auswerten, transkribieren, zusammenfassen darf – dann reden wir hier über ganz brisante Punkte im persönlichen Datenschutz. Für mich ist das insgesamt eine totale Verletzung des Schutzraums.

Auch dann, wenn alle Einwilligungen formal eingeholt wurden. Auch dann, wenn technisch die große Online-Plattform im Gesundheitsbereich ein besonderes Vertrauen genießt und der Cloudanbieter ein sehr großer US Konzern ist, der extra die Server dafür in Europa betreibt (wie auch immer das geprüft wird). Selbst dann, wenn irgendwo steht, dass Alles wirklich sicher sei. Selbst dann, wenn der technische Anbieter betont, dies diene nur der Arbeitserleichterung.

Auch Einwilligungen sind nicht immer ein-willig

Therapeutische Beziehungen sind keine gewöhnlichen Geschäftsbeziehungen. Wer Hilfe sucht, ist oft verletzlich – und möchte nicht schwierig sein. Es braucht hier besonderen Schutz. Und „ist schon okay“, sagen wir Menschen oftmals gerade dann, wenn es nicht ganz okay ist. Ich denke hier auch an Arztpraxen, nicht nur an Therapie, wo wir auch hingehen, wenn wir gerade nicht im Vollbesitz unserer Kräfte sind.

Selbst wenn Jemand*e zustimmt, ist die Frage: Können wir als Klientin*innen in dem Moment wirklich überblicken, was es bedeutet, wenn eine KI mithört? Was lassen sich aus diesen Daten alles für Informationen ziehen? Text, Stimme, Sprachmuster, Sprechtempo, Pausen, Tonalität, phonetische Artikulation, emotionale Marker…?

Die elektronische Patientenakte rauscht eh im Hintergrund

Ich habe an anderer Stelle bereits über die elektronische Patientenakte geschrieben. Auch dort geht es um eine ähnliche Grundfrage: Wie gehen wir mit hochsensiblen Gesundheitsinformationen um, wenn immer mehr davon in zentralen oder weit vernetzten Systemen landen?

Bei körperlichen Erkrankungen ist Datenschutz auch wichtig. Bei psychischen Themen kommt noch eine besondere Dimension hinzu: Eine (aktuelle) Krise, eine Angststörung, eine Traumafolgestörung, depressive Episoden, familiäre Konflikte oder intime biografische Details sind keine neutralen Informationen. Sie können, wenn sie in falsche Hände geraten oder von nicht eng damit befassten Personen gelesen werden, vielleicht nur unangenehme Situationen erzeugen oder auch ganz erheblichen Schaden anrichten.

Datenschutz beginnt für mich bei der Frage, ob bestimmte Daten überhaupt entstehen sollten.

Ist es therapeutisch sinnvoll?

Und wenn eine KI nach der Stunde die Zusammenfassung schreibt, geht dann nicht auch etwas Wichtiges verloren?

Dokumentation ist für mich nicht bloß Verwaltung. Gute therapeutische Notizen sind auch ein Moment der inneren Nachbereitung und Reflexion.

Als Therapeut gehe ich nach einer Sitzung kurz in Resonanz: Welche Momente leuchten für mich noch nach? Wo fühlte ich eine Bewegung? Wo empfand ich Abwehr? Was hat mich irritiert (super spannend!)? Was blieb offen? Welche Stimmung war für mich im Raum? Was habe ich selbst noch nicht verstanden?

Diese Besinnung, verbunden mit dem Prozess des Schreibens (mit einem Stift, auf Papier) ist nicht nur Protokoll.

Es ist ganz wertvolle Verarbeitung.

Der therapeutische Schutzraum ist keine Datenquelle

Ich bleib für mich dabei: Der Therapieraum ist kein Rohstofflager für Sprachdaten, Emotionsmuster oder psychotherapeutische Inhalte. Es ist ein besonderer Schutzraum. Und Schutz bedeutet hierbei auch: technische Möglichkeiten bewusst nicht zu nutzen.

Nicht effizient, aber manchmal gerade deshalb richtig.